Praktischer Ratgeber zum AI Act 2026: Deepfakes und KI-Texte richtig kennzeichnen

Ab dem 2. August 2026 gelten in der EU die Transparenzpflichten der KI-Verordnung (englisch “AI Act”, Verordnung (EU) 2024/1689). Anbieter und Betreiber von KI-Systemen müssen KI-generierte Inhalte und KI-Interaktionen als solche erkennbar machen. Bei Verstößen drohen Bußgelder von bis zu 15 Millionen Euro oder 3 Prozent des weltweiten Jahresumsatzes.

Die Pflichten betreffen nicht nur große Technologieunternehmen. Jedes Unternehmen, jede Behörde und jeder Selbstständige, der KI-Systeme beruflich nutzt oder unter eigenem Namen bereitstellt, muss die neuen Vorgaben beachten. Kennzeichnungspflichten ergeben sich dabei nicht allein aus der KI-Verordnung, sondern auch aus dem Wettbewerbsrecht, Plattformregeln, vertraglichen Vereinbarungen und dem Persönlichkeitsrecht.

Welche Fragen beantwortet dieser Ratgeber? Er erklärt, welche Inhalte kennzeichnungspflichtig sind, wen die Pflichten treffen, wie die Kennzeichnung erfolgen muss und welche Rechtsfolgen bei Verstößen drohen. Er richtet sich an Unternehmen, Selbstständige und alle, die KI-generierte Inhalte veröffentlichen oder KI-Systeme bereitstellen.

Inhalt des Beitrags:

Zusammenfassung

Ab dem 2. August 2026 müssen Unternehmen, Behörden, Selbstständige und sonstige berufliche Nutzer von KI-Systemen Deepfakes, also realistisch wirkende KI-Bilder, Videos oder Audios mit Bezug zu realen Personen, Orten, Gegenständen oder Ereignissen, klar, sichtbar, verständlich und barrierefrei kennzeichnen. Gleiches gilt für zur Information der Öffentlichkeit bestimmte KI-Texte, wenn sie ohne echte redaktionelle Kontrolle veröffentlicht werden. KI-Anbieter müssen ab dem 2. Dezember 2026 zudem alle synthetischen Inhalte maschinenlesbar kennzeichnen und Interaktionen mit KI-Systemen für Nutzer als solche erkennbar machen.

Welche Transparenzpflichten bestehen nach der KI-Verordnung?

Artikel 50 der KI-Verordnung verpflichtet Anbieter und Betreiber von KI-Systemen zur Transparenz gegenüber Nutzern und der Öffentlichkeit. Die Pflichten lassen sich in vier Kategorien einteilen:

- KI-Interaktionen erkennbar machen (Art. 50 Abs. 1): KI-Anbieter müssen sicherstellen, dass Nutzer erkennen können, wenn sie mit einer KI statt mit einem Menschen kommunizieren, etwa bei Chatbots.

- Maschinenlesbare Kennzeichnung (Art. 50 Abs. 2): KI-Anbieter müssen KI-generierte Audio-, Bild-, Video- und Textinhalte maschinenlesbar als KI-Erzeugnisse kennzeichnen, etwa durch Metadaten oder Wasserzeichen.

- Deepfakes offenlegen (Art. 50 Abs. 4 S. 1): KI-Betreiber müssen offenlegen, wenn KI-generierte Inhalte reale Personen, Gegenstände, Orte, Einrichtungen oder Ereignisse realistisch darstellen und als echt erscheinen könnten.

- KI-Texte kennzeichnen (Art. 50 Abs. 4 S. 4): KI-Betreiber müssen offenlegen, wenn KI-generierte Texte der Information der Öffentlichkeit dienen und keine redaktionelle Kontrolle stattgefunden hat.

- Emotionserkennung und biometrische Kategorisierung (Art. 50 Abs. 3): Betreiber von Emotionserkennungssystemen oder Systemen zur biometrischen Kategorisierung müssen betroffene Personen über den Betrieb des Systems informieren. Eine Ausnahme gilt für KI-Systeme, die gesetzlich zur Aufdeckung, Verhütung oder Ermittlung von Straftaten zugelassen sind.

Zusätzlich können sich Kennzeichnungspflichten aus Wettbewerbsrecht, Vertragsrecht, Plattformregeln und internen Richtlinien ergeben.

Ab wann gelten die Transparenz- und Kennzeichnungspflichten der KI-Verordnung?

Die Kennzeichnungspflichten der KI-Betreiber für Deepfakes und KI-generierte Informationstexte gelten ab dem 2. August 2026. Das gilt nach derzeitigem Stand für die Emotionserkennung und biometrische Kategorisierung.

Für die Kennzeichnung von KI-Interaktionen nach Art. 50 Abs. 1 KI-Verordnung und die maschinenlesbare Kennzeichnung synthetischer Inhalte nach Art. 50 Abs. 2 gelten Fristen, die ab dem 2. November 2026 erfüllt werden müssen.

Welche Rechtsfolgen drohen bei Verstößen gegen die KI-Kennzeichnungspflichten?

Verstöße gegen die Transparenzpflichten können erhebliche Konsequenzen haben:

- Bußgelder: Bis zu 15 Millionen Euro oder 3 Prozent des weltweiten Jahresumsatzes, je nachdem, welcher Betrag höher ist (Art. 99 KI-VO).

- Wettbewerbsrechtliche Abmahnungen: Verstöße können nach Auffassung der Wettbewerbszentrale zugleich als unlauterer Wettbewerb nach dem UWG gewertet werden, sodass Konkurrenten und Verbände Unterlassungsansprüche geltend machen können.

- Zivilrechtliche Ansprüche: Betroffene Personen können Unterlassung und Schadensersatz verlangen, insbesondere bei Verletzung von Persönlichkeitsrechten.

- Plattformsanktionen: Löschung von Inhalten, Reichweitenbeschränkungen oder Accountsperrungen durch Plattformbetreiber.

- Arbeitsrechtliche Maßnahmen: Im beruflichen Kontext können dienst- oder arbeitsrechtliche Konsequenzen drohen.

Wann kann eine fehlende KI-Kennzeichnung strafbar sein?

Eine fehlende KI-Kennzeichnung allein ist nach der KI-Verordnung keine Straftat, sondern eine Ordnungswidrigkeit. Strafrechtlich relevant wird sie jedoch, wenn durch den nicht gekennzeichneten KI-Inhalt zusätzlich Straftatbestände verwirklicht werden.

Besonders relevant sind die Ehrverletzungsdelikte des Strafgesetzbuchs:

- Beleidigung (§ 185 StGB): Freiheitsstrafe bis zu zwei Jahren, wenn ein Deepfake den Ruf einer Person schädigt.

- Üble Nachrede (§ 186 StGB): Freiheitsstrafe bis zu zwei Jahren bei öffentlicher Verbreitung unwahrer Tatsachenbehauptungen durch KI-Inhalte.

- Verleumdung (§ 187 StGB): Freiheitsstrafe bis zu fünf Jahren bei wissentlich unwahren Darstellungen, die öffentlich verbreitet werden.

Auch Betrug (§ 263 StGB) kann einschlägig sein, etwa wenn mittels nicht gekennzeichneter KI-Inhalte eine Täuschung im Geschäftsverkehr erfolgt.

Welche KI-Inhalte müssen Betreiber (Nutzer) kennzeichnen?

Betreiber von KI-Systemen müssen nach der KI-Verordnung zwei Kategorien von Inhalten kennzeichnen:

- Deepfakes (Art. 50 Abs. 4 S. 1 KI-VO): KI-generierte oder wesentlich manipulierte Bild-, Video- oder Audioinhalte, die realen Personen, Orten, Gegenständen, Einrichtungen oder Ereignissen ähneln und so realistisch wirken, dass sie als echt erscheinen könnten.

- KI-generierte Texte von öffentlichem Interesse (Art. 50 Abs. 4 S. 4 KI-VO): Texte, die mittels KI erzeugt oder manipuliert wurden und der Information der Öffentlichkeit dienen, sofern keine redaktionelle Kontrolle stattgefunden hat.

Nicht jeder KI-generierte Inhalt ist kennzeichnungspflichtig. Die Pflicht hängt ab von der Art des Inhalts, dem Realitätsbezug, dem Veröffentlichungszweck und dem Grad menschlicher Kontrolle. Daneben können sich weitergehende Pflichten aus Plattformregeln, vertraglichen Vereinbarungen oder dem Wettbewerbsrecht ergeben.

Wer gilt als Betreiber im Sinne der KI-Verordnung?

Als Betreiber gilt nach Artikel 3 Nr. 4 KI-Verordnung jede natürliche oder juristische Person, Behörde oder sonstige Stelle, die ein KI-System in eigener Verantwortung verwendet. Der Begriff ist weit gefasst und erfasst insbesondere:

- Unternehmen jeder Größe, die KI-Tools wie ChatGPT, Midjourney oder Microsoft Copilot beruflich einsetzen,

- Soloselbstständige und Freiberufler,

- Social-Media-Verantwortliche und Marketingagenturen,

- Behörden und öffentliche Stellen.

Nicht als Betreiber gelten einzelne Mitarbeitende eines Unternehmens oder anderer Organsiationen. Ebenso sind die Anbieter der KI-Systeme selbst (z. B. OpenAI oder Anthropic) keine Betreiber. Für sie gelten die weiter unten genannten besonderen Transparenzpflichten.

Gilt die Kennzeichnungspflicht auch bei rein privater Nutzung?

Die KI-Verordnung nimmt natürliche Personen aus, die KI-Systeme im Rahmen einer ausschließlich persönlichen und nicht beruflichen Tätigkeit verwenden (Art. 2 Abs. 10 KI-VO). Wer ein KI-Bild erstellt und nur im engen Freundeskreis teilt, dürfte darunter fallen.

Ob die Ausnahme auch bei einer Veröffentlichung von Deepfakes in sozialen Netzwerken greift, ist noch ungeklärt. Im Datenschutzrecht wird eine öffentliche Zugänglichmachung z.B. nicht als rein persönliche Nutzung angesehen (EuGH, Lindqvist, Rs. C-101/01). Zumindest dann, wenn Einfluss auf den politischen Diskurs genommen werden soll, z. B. wenn Deepfakes von Politikern gepostet werden, sollten auch Privatpersonen sie als KI-Ergebnisse kennzeichnen.

Im Zweifel empfiehlt sich eine Kennzeichnung, sobald Deepfakes über den engsten privaten Kreis hinaus geteilt werden.

Was sind Deepfakes im Sinne der KI-Verordnung?

Ein Deepfake liegt gemäß Artikel 3 Nr. 60 KI-Verordnung vor, wenn drei Voraussetzungen zusammentreffen:

- Der Inhalt wurde durch KI erzeugt oder wesentlich manipuliert.

- Er stellt real existierende Personen, Orte, Gegenstände, Einrichtungen oder Ereignisse dar.

- Er wirkt dabei so realistisch, dass er als echt erscheinen kann.

Es muss also nicht immer eine echte Person sein, die nachgebildet oder manipuliert wird. Auch ein KI-generiertes Bild, das eine fiktive Person, aber an einem realen Ort zeigt, kann ein Deepfake sein. Entscheidend ist der Realitätsbezug in Verbindung mit der Eignung zur Täuschung.

Wann liegt eine Manipulation mittels KI vor?

Eine Manipulation im Sinne der KI-Verordnung setzt voraus, dass ein bestehender Inhalt durch KI wesentlich verändert wurde. Nicht jede KI-gestützte Bearbeitung löst eine Kennzeichnungspflicht aus. Entscheidend ist der tatsächliche inhaltliche Einfluss der KI auf das Ergebnis.

Keine Manipulation liegt vor bei:

- Rechtschreibkorrektur oder Grammatikprüfung durch KI,

- Automatischer Bildoptimierung (z. B. Helligkeit, Kontrast, Bildstabilisierung),

- KI-gestützter Standardbearbeitung, die den Inhalt oder seine Aussage nicht wesentlich verändert.

Eine Manipulation liegt vor bei:

- Austausch oder Einfügen von Gesichtern (Face-Swaps),

- Erzeugung neuer Bildelemente, die reale Szenen vortäuschen,

- inhaltlicher Veränderung von Aussagen in Audio- oder Videoaufnahmen,

- erheblicher Veränderung der Bildkomposition, die einen neuen Gesamteindruck erzeugt.

Die KI-Verordnung stellt in Art. 50 Abs. 2 klar, dass KI-Systeme, die lediglich eine unterstützende Funktion für die Standardbearbeitung ausführen oder die Eingabedaten nicht wesentlich verändern, von der Kennzeichnungspflicht ausgenommen sind.

Wann ist ein KI-Bild kein kennzeichnungspflichtiges Deepfake?

Kein kennzeichnungspflichtiges Deepfake liegt in der Regel vor, wenn die Darstellung keinen ausreichenden Bezug zur Realität aufweist oder zur Täuschung nicht geeignet ist. Beispiele:

Kein Realitätsbezug:

- Offensichtlich abstrakte, symbolische oder fantastische Motive.

- Comic- oder Cartoon-Darstellungen, die erkennbar nicht echt sind.

- Eindeutig unrealistische Szenen, etwa Drachen, fliegende Menschen ohne Hilfsmittel oder physikalisch unmögliche Ereignisse.

- Darstellungen, die nach Gestaltung, Kontext und Begleittext klar als fiktiv, künstlerisch oder fantasievoll erkennbar sind.

Aber Vorsicht, es kann für eine Kennzeichnungspflicht ausreichen, dass der Inhalt insgesamt realistisch wirkt und Personen, Orte, Gegenstände oder Ereignisse zeigt, die es in dieser Form geben könnte oder dass durch die Umstände der Eindruck erweckt wird, sie könnten echt sein, wie in diesem Bildbeispiel:

Allerdings können sich auch bei nicht kennzeichnungspflichtigen Bildern Pflichten aus Plattformregeln ergeben. Viele soziale Netzwerke verlangen eine Kennzeichnung aller realistisch wirkenden KI-Inhalte, unabhängig davon, ob reale Personen oder Ereignisse dargestellt werden.

Muss eine Täuschunsgabsicht vorliegen?

Für die Kennzeichnungspflicht kommt es nicht darauf an, ob der Ersteller oder Betreiber jemanden täuschen wollte. Entscheidend ist, ob der KI-generierte oder wesentlich manipulierte Inhalt objektiv geeignet ist, als echt oder authentisch wahrgenommen zu werden.

Ein Deepfake kann daher auch dann kennzeichnungspflichtig sein, wenn es nur zur Illustration, Unterhaltung, Schulung oder Werbung erstellt wurde. Maßgeblich ist die Wirkung auf durchschnittliche Nutzer, nicht die innere Absicht des Erstellers.

Müssen auch KI-generierte Produktbilder in der Werbung gekennzeichnet werden?

Diese Frage ist rechtlich noch nicht abschließend geklärt und wird unter Juristen kontrovers diskutiert. Entscheidend ist, ob ein KI-generiertes Produktbild die Voraussetzungen eines Deepfakes erfüllt.

Eine Kennzeichnungspflicht besteht in jedem Fall, wenn ein konkreter Gegenstand verkauft oder vermietet werden soll, z.B. ein gebrauchtes Kraftfahrzeug.

Unklar ist dagegen, ob auch Produktbilder, die Massenprodukte repräsentieren, ebenfalls unter die Kennzeichnungspflicht fallen. Z.B. das KI-Generierte Bild eines Neuwagens, der auf Plakaten für das neue Modell wirbt.

Gegen eine Kennzeichnungspflicht sprichen folgende Argumente:

- Produktbilder wurden schon vor KI routinemäßig mit Bildbearbeitung erstellt oder am Computer gerendert, ohne dass dies beanstandet wurde.

- Bei Massenware (z. B. Werbebilder für eine Automodellreihe) erwarten Verbraucher in der Regel nicht, genau das abgebildete Exemplar zu erhalten.

- Solange keine Täuschung über wesentliche Produkteigenschaften vorliegt, fehlt es an der Täuschungseignung.

Im Zweifel ist eine Kennzeichnung empfehlenswert, da die Gerichte die Abgrenzung noch nicht konkretisiert haben. Unabhängig von der KI-Verordnung kann eine Irreführung über Produkteigenschaften durch KI-Bilder auch wettbewerbsrechtlich unzulässig sein.

Welchen Inhalt muss die KI-Kennzeichnung haben?

Die KI-Verordnung schreibt keinen festen Wortlaut vor. Die Kennzeichnung muss nach Art. 50 Abs. 5 KI-VO jedoch klar, eindeutig und für durchschnittliche Nutzer verständlich sein.

Geeignete Formulierungen sind zum Beispiel:

- „KI-generiert”.

- „Mit KI erstellt”.

- „KI-Bild” bzw. „KI-Video”.

Eingeschränkt geeignet:

- Die bloßen Buchstaben „KI” können bei sachkundigem Publikum und mit zunehmender Verbreitung von KI-Kennzeichnungen ausreichen, sofern sie deutlich platziert sind.

- Der englische Begriff „AI” ist im deutschsprachigen Raum problematisch, da er außerhalb von Fachkreisen oft nicht verstanden wird.

Nicht ausreichend:

- Versteckte Hinweise in AGB, im Impressum oder am Ende eines längeren Beitrags.

- Vage Formulierungen wie „von KI unterstützt”, wenn der Inhalt tatsächlich vollständig KI-generiert ist.

- Symbole der KI-Anwendungen (z. B. die Raute von Google Gemini in der rechten unteren Ecke der Bilder, die auch auf den Bildern in diesem Beitrag zu sehen ist).

Rechtlich besonders belastbar ist eine doppelte Kennzeichnung, also ein sichtbarer Hinweis im Inhalt selbst (z. B. als Wasserzeichen) und zusätzlich ein Hinweis in der Beschreibung oder im Begleittext.

Wo muss die KI-Kennzeichnung platziert werden?

Die Kennzeichnung muss so platziert sein, dass Nutzer sie spätestens beim ersten Kontakt mit dem Inhalt wahrnehmen können (Art. 50 Abs. 5 KI-VO). Die KI-Verordnung macht keine exakten Vorgaben zur Position, stellt aber klare Mindestanforderungen.

Geeignete Platzierungen:

- Bei Bildern: sichtbares Wasserzeichen im Bild selbst, ergänzt durch einen Hinweis im Begleittext.

- Bei Videos: Einblendung vor Beginn oder dauerhaft sichtbar im Bild.

- Bei Audio: akustischer Hinweis zu Beginn, bei längeren Inhalten ggf. auch zwischendurch.

- Bei Texten: gut sichtbarer Hinweis zu Beginn des Textes, noch vor dem eigentlichen Inhalt.

Nicht ausreichend sind:

- Hinweise erst am Ende eines Beitrags oder Videos,

- versteckte Angaben im Impressum, in AGB oder auf separaten Informationsseiten,

- Hinweise, die nur durch Scrollen oder zusätzliche Klicks erreichbar sind.

- Deepfakes als Teaserbilder ohne KI-Kennzeichnung, auch wenn der verlinkte Beitrag über eine Kennzeichnung verfügt.

Entscheidend ist, dass keine Fehlvorstellung über den KI-Ursprung entstehen kann, bevor der Nutzer den Inhalt wahrnimmt.

In welcher Sprache muss die KI-Kennzeichnung erfolgen?

Die KI-Verordnung enthält keine ausdrückliche Sprachvorgabe. Die Kennzeichnung muss jedoch „klar und eindeutig” sein, was bedeutet, dass sie von der jeweiligen Zielgruppe verstanden werden muss.

Für den deutschsprachigen Markt empfiehlt sich eine Kennzeichnung auf Deutsch. Deutsche Gerichte haben bereits bei der Kennzeichnung von Influencer-Werbung englische Begriffe wie „#ad” oder „#sponsoredby” kritisch bewertet. Diese Rechtsprechung dürfte auf die KI-Kennzeichnung übertragbar sein.

Empfehlenswert sind daher:

- Deutsche Begriffe wie „KI-generiert”, „Mit KI erstellt” oder „KI-Bild”.

- Der englische Begriff „AI” sollte im deutschsprachigen Raum vermieden werden, da er außerhalb von Fachkreisen oft nicht verstanden wird.

Bei international ausgerichteten Inhalten kann eine mehrsprachige Kennzeichnung sinnvoll sein. Für Plattformen mit überwiegend fachkundigem Publikum wird im Einzelfall auch ein englischer Begriff ausreichen.

Muss die KI-Kennzeichnung barrierefrei sein?

Ja. Artikel 50 Abs. 5 KI-Verordnung verlangt ausdrücklich, dass die Kennzeichnung den geltenden Barrierefreiheitsanforderungen entsprechen muss. Das bedeutet in der Praxis:

- Visuelle Kennzeichnungen müssen ausreichende Kontraste aufweisen und in einer lesbaren Schriftgröße dargestellt werden.

- Textbasierte Hinweise müssen für Screenreader lesbar sein, damit auch sehbeeinträchtigte Nutzer die Kennzeichnung erfassen können.

- Bei Audioinhalten muss der Hinweis akustisch wahrnehmbar sein.

- Bei Videoinhalten sollte der Hinweis sowohl visuell als auch ggf. akustisch erfolgen.

In Deutschland sind zusätzlich die Anforderungen des Barrierefreiheitsstärkungsgesetzes (BFSG) zu beachten, das ab Juni 2025 gilt und digitale Angebote an Verbraucher betrifft. Unternehmen sollten die KI-Kennzeichnung daher von Anfang an barrierefrei gestalten.

Müssen nicht zur Veröffentlichung bestimmte Inhalte gekennzeichnet werden?

Grundsätzlich ja, wenn die Voraussetzungen eines Deepfakes nach Art. 50 Abs. 4 KI-VO erfüllt sind. Das Gesetz verlangt nicht ausdrücklich eine Veröffentlichung gegenüber der Öffentlichkeit. Sie spricht davon, dass Betreiber offenlegen müssen, dass bestimmte Inhalte künstlich erzeugt oder manipuliert wurden.

Für rein interne Deepfakes bedeutet das:

- Kennzeichnung eher erforderlich, wenn das Deepfake innerhalb eines Unternehmens Beschäftigten, Kunden, Dienstleistern oder sonstigen Personen gezeigt wird und realistisch als echt erscheinen kann. Beispiel: Ein realistisch wirkendes KI-Video des Geschäftsführers mit einer angeblichen Anweisung an Mitarbeitende.

- Kennzeichnung eher nicht erforderlich, wenn der Inhalt nur in einem geschlossenen Produktions-, Test- oder Entwurfsprozess verwendet wird, nicht zur Wahrnehmung durch Dritte bestimmt ist und keine Person über die Echtheit getäuscht werden kann.

Praktisch empfehlenswert ist bei internen Deepfakes trotzdem eine klare Kennzeichnung, sobald die KI-Ergebnisse intern weitergegeben werden oder andere Mitarbeitende auf sie Zugriff erhalten.

Welche Ausnahme gilt für Kunst und Satire?

Für offensichtlich künstlerische, kreative, satirische oder fiktionale Werke sieht die KI-Verordnung eine abgeschwächte Kennzeichnungspflicht vor (Art. 50 Abs. 4 S. 3 KI-VO). Der KI-Ursprung muss zwar weiterhin erkennbar bleiben, die Offenlegung darf aber in einer Weise erfolgen, die die Darstellung oder den Genuss des Werks nicht beeinträchtigt.

In der Praxis bedeutet das zum Beispiel:

- Ein satirisches KI-Video darf die KI-Kennzeichnung am Ende statt am Anfang tragen, wenn eine Vorab-Kennzeichnung den satirischen Effekt zerstören würde.

- KI-Werke in einer Kunstausstellung oder Satirerubrik können durch einen allgemeinen Hinweis gekennzeichnet werden, der auf KI-Inhalte in der Gesamtpräsentation verweist.

Wichtige Einschränkungen:

- Im beruflichen und insbesondere im werblichen Kontext ist diese Ausnahme eng auszulegen. Es empfiehlt sich, im geschäftlichen Umfeld auf die Ausnahme zu verzichten.

- Auch bei Kunst und Satire müssen Persönlichkeitsrechte, Urheberrecht und Datenschutz eigenständig geprüft werden. Die Ausnahme betrifft nur die Art der Kennzeichnung, nicht die Rechtmäßigkeit des Inhalts.

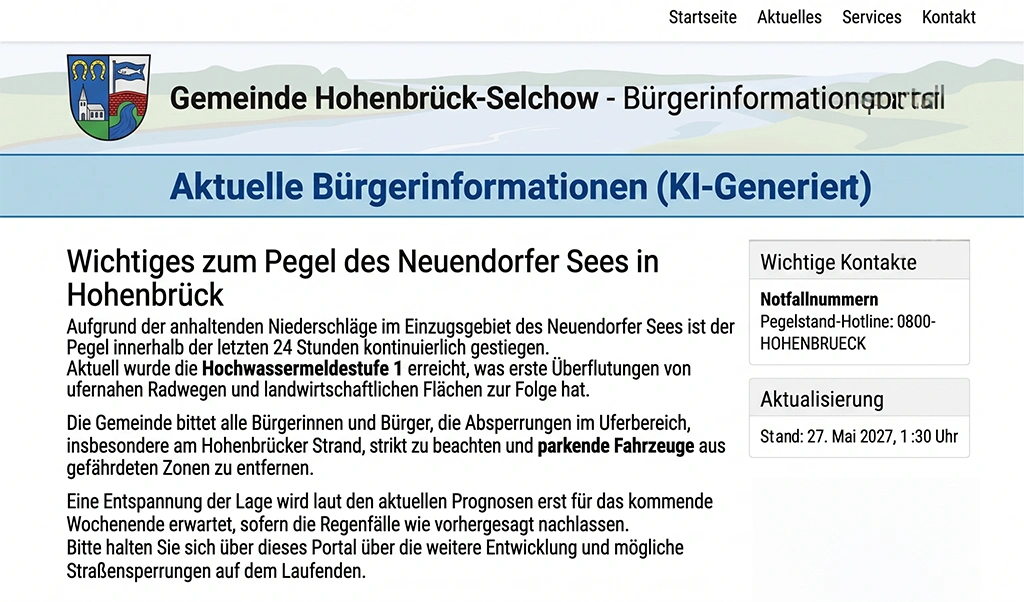

Müssen KI-generierte Texte gekennzeichnet werden?

Die KI-Verordnung enthält eine Kennzeichnungspflicht für KI-generierte Texte, die jedoch nur einen eng begrenzten Anwendungsbereich betrifft (Art. 50 Abs. 4 S. 4 KI-VO). Eine Kennzeichnung ist erforderlich, wenn drei Voraussetzungen zusammentreffen:

- Der Text dient der Information der Öffentlichkeit über Angelegenheiten von öffentlichem Interesse.

- Der Text wurde ganz oder überwiegend durch KI erzeugt.

- Es hat keine echte menschliche redaktionelle Kontrolle stattgefunden.

Erfasst sind insbesondere:

- Von KI geschriebene Nachrichtenartikel in Online-Magazinen,

- KI-generierte Bürgerinformationen von Behörden,

- Pressemitteilungen, die sich an die Öffentlichkeit richten (z. B.: Produktwarnungen).

Maßgeblich ist der objektive Informationszweck des Textes, nicht die Plattform, auf der er veröffentlicht wird. Wird die KI lediglich als Hilfswerkzeug eingesetzt, etwa zur Rechtschreibkorrektur oder Argumentationshilfe, und ist der Text im Wesentlichen von einem Menschen erstellt, besteht keine Kennzeichnungspflicht.

Wann entfällt die Kennzeichnungspflicht bei redaktioneller Kontrolle?

Die Kennzeichnungspflicht für KI-Texte entfällt, wenn zwei Bedingungen erfüllt sind:

- Eine echte menschliche inhaltliche Kontrolle hat stattgefunden, und

- eine natürliche oder juristische Person übernimmt die redaktionelle Verantwortung für die Veröffentlichung.

Dabei ist mit redaktioneller Kontrolle eine substanzielle inhaltliche Prüfung gemeint, die Richtigkeit, Vollständigkeit und mögliche Irreführungen umfasst.

Nicht ausreichend sind:

- Eine bloße Plausibilitätsprüfung oder formale Durchsicht,

- automatisiertes Gegenlesen ohne echte inhaltliche Befassung,

- die reine Freigabe durch Anklicken ohne substanzielle Prüfung.

Die Ausnahme setzt also voraus, dass ein Mensch den Inhalt tatsächlich verstanden, geprüft und verantwortet hat.

Sollte die redaktionelle Kontrolle dokumentiert werden?

Eine Dokumentationspflicht besteht nach der KI-Verordnung zwar nicht ausdrücklich. In der Praxis ist eine Dokumentation jedoch dringend empfehlenswert, um im Streitfall nachweisen zu können, dass eine verantwortliche menschliche Kontrolle stattgefunden hat.

Sinnvolle Maßnahmen sind:

- Festhalten, welche Person den Text wann inhaltlich geprüft hat,

- Dokumentation der vorgenommenen Änderungen und Korrekturen,

- Benennung der redaktionell verantwortlichen Person, etwa im Impressum oder in den Veröffentlichungsangaben.

Ohne eine solche Dokumentation besteht das Risiko, dass im Fall einer behördlichen Prüfung oder eines Rechtsstreits die redaktionelle Kontrolle nicht glaubhaft nachgewiesen werden kann und die Kennzeichnungspflicht nachträglich als verletzt angesehen wird.

Müssen auch Werbetexte und Marketingtexte als KI-generiert gekennzeichnet werden?

Nach der KI-Verordnung nein. Die Kennzeichnungspflicht für KI-Texte erfasst nur Texte, die der Information der Öffentlichkeit über Angelegenheiten von öffentlichem Interesse dienen.

Nicht erfasst sind daher typischerweise:

- Werbetexte und Anzeigen,

- Marketing- und Produktbeschreibungen,

- interne Kommunikation,

- unterhaltende Beiträge ohne Informationsanspruch,

- Social-Media-Posts mit rein werblichem Charakter.

Welche Informationspflichten gelten bei Emotionserkennung und biometrischer Kategorisierung?

Betreiber von Emotionserkennungssystemen oder Systemen zur biometrischen Kategorisierung müssen betroffene Personen darüber informieren, dass ein solches System eingesetzt wird (Art. 50 Abs. 3 KI-Verordnung). Die Informationspflicht gilt unabhängig davon, ob das System als Hochrisiko-KI eingestuft ist. Zusätzlich müssen personenbezogene Daten im Einklang mit der DSGVO verarbeitet werden.

- Emotionserkennung erfasst Systeme, die emotionale Zustände von Personen erkennen oder ableiten, etwa anhand von Mimik, Stimme oder Körperhaltung.

Biometrische Kategorisierung betrifft Systeme, die Personen anhand biometrischer Daten in Gruppen einordnen, etwa nach Alter, Geschlecht oder ethnischer Herkunft.

Ausnahme: Die Informationspflicht gilt nicht für KI-Systeme, die gesetzlich zur Aufdeckung, Verhütung oder Ermittlung von Straftaten zugelassen sind, sofern geeignete Schutzvorkehrungen für die Rechte Dritter bestehen.

Welche Kennzeichnungspflichten gelten für Anbieter von KI-Systemen?

Anbieter von KI-Systemen treffen nach der KI-Verordnung eigenständige Transparenzpflichten, die sich von den Betreiberpflichten unterscheiden. Sie betreffen zwei Bereiche:

Erkennbarkeit von KI-Interaktionen (Art. 50 Abs. 1): Anbieter müssen sicherstellen, dass Nutzer erkennen können, wenn sie mit einem KI-System statt mit einem Menschen interagieren. Das betrifft insbesondere Chatbots, KI-Assistenten und automatisierte Dialog- oder Sprachsysteme.

Maschinenlesbare Kennzeichnung synthetischer Inhalte (Art. 50 Abs. 2): Anbieter von KI-Systemen, die Bilder, Videos, Audio oder Text erzeugen, müssen diese Inhalte in einem maschinenlesbaren Format als KI-generiert kennzeichnen. Ziel ist, dass Dritte (z. B. Plattformen) den KI-Ursprung technisch feststellen können.

Diese Pflichten treffen nicht nur große Technologieunternehmen, sondern jedes Unternehmen oder jede Behörde, die unter eigenem Namen ein KI-System oder eine KI-Funktion bereitstellt.

Wer gilt als Anbieter im Sinne der KI-Verordnung?

Als Anbieter gilt nach Artikel 3 Nr. 3 KI-Verordnung, wer ein KI-System oder eine KI-Funktion unter eigenem Namen oder eigener Marke entwickelt oder entwickeln lässt und bereitstellt. Entscheidend ist nicht die technische Entwicklung des zugrunde liegenden KI-Modells, sondern die Bereitstellung unter eigenem Namen.

Anbieter ist daher auch:

- Ein Unternehmen, das eine externe KI (z. B. eine API von OpenAI) in eine eigene Anwendung integriert und diese gegenüber Nutzern als eigene Lösung anbietet.

- Eine Behörde, die einen KI-Chatbot auf ihrer Website unter eigenem Namen betreibt.

- Ein Softwareunternehmen, das ein KI-gestütztes Tool unter eigener Marke vertreibt.

Nicht als Anbieter gilt, wer ein KI-System lediglich als fertiges Produkt eines Dritten nutzt, ohne es unter eigenem Namen bereitzustellen. Solche Unternehmen sind in der Regel Betreiber.

Wann müssen Chatbots und KI-Assistenten als KI erkennbar sein?

Anbieter müssen sicherstellen, dass Nutzer spätestens zu Beginn der Interaktion erkennen können, dass sie mit einem KI-System und nicht mit einem Menschen kommunizieren (Art. 50 Abs. 1 KI-VO). Der Hinweis muss klar, verständlich und eindeutig erfolgen.

Geeignete Umsetzungen sind:

- Eine Begrüßungsnachricht wie „Sie chatten hier mit einem KI-Assistenten”,

- ein dauerhaft sichtbarer Hinweis im Chat-Fenster,

- eine entsprechende Benennung des Systems (z. B. „KI-Assistent” statt eines menschlichen Namens).

Nicht ausreichend sind:

- Versteckte Hinweise in AGB oder im Impressum,

- die Formulierung „von KI unterstützt”, wenn tatsächlich ausschließlich eine KI kommuniziert (dies könnte den Eindruck erwecken, ein Mensch werde lediglich durch KI unterstützt),

- Hinweise, die erst nach Beginn der Interaktion erscheinen.

Eine Kennzeichnung ist ausnahmsweise entbehrlich, wenn es aus den Umständen offensichtlich ist, dass es sich um ein KI-System handelt, etwa weil Name und Erscheinungsbild des Systems dies klar erkennen lassen. Im Zweifel sollte der Chatbot jedoch gekennzeichnet werden.

Müssen auch KI-Agenten gekennzeichnet werden?

Auch KI-Agenten müssen von ihren Anbietern gekennzeichnet werden, wenn sie direkt mit natürlichen Personen interagieren. Das betrifft z. B. Agenten, die selbstständig E-Mails versenden, Chatnachrichten beantworten, Kundensupport leisten oder in sozialen Netzwerken kommunizieren.

Nutzer müssen spätestens zu Beginn der Interaktion erkennen können, dass sie mit einem KI-System und nicht mit einem Menschen kommunizieren. Geeignet sind klare Hinweise wie „Sie kommunizieren mit einem KI-Agenten“ oder „Diese Nachricht wurde von einem KI-Agenten erstellt“.

Versteckte Hinweise in AGB, Impressum oder internen Richtlinien reichen nicht aus. Erzeugt der Agent Deepfakes oder KI-Texte von öffentlichem Interesse, können zusätzliche Kennzeichnungspflichten bestehen.

Welche KI-generierten Inhalte müssen Anbieter kennzeichnen?

Anbieter müssen nach Art. 50 Abs. 2 KI-Verordnung sicherstellen, dass alle durch ihr KI-System erzeugten oder wesentlich manipulierten Inhalte maschinenlesbar als KI-Erzeugnisse identifizierbar sind. Das betrifft sämtliche synthetischen Inhalte, also Bilder, Videos, Audiodateien und Texte.

Geeignete technische Maßnahmen sind:

- Einbettung von Metadaten in die erzeugten Dateien,

- digitale Wasserzeichen,

- kryptografische Methoden zum Herkunftsnachweis,

- Fingerabdrucktechnologien oder eine Kombination dieser Verfahren.

Die technischen Lösungen müssen wirksam, interoperabel, belastbar und zuverlässig sein und dem allgemein anerkannten Stand der Technik entsprechen.

Ausgenommen sind KI-Systeme, die:

- lediglich eine unterstützende Funktion für die Standardbearbeitung ausführen (z. B. automatische Bildoptimierung),

- die Eingabedaten oder deren Aussage nicht wesentlich verändern.

In der Praxis bedeutet das: Dritte, etwa Online-Plattformen, können den KI-Ursprung von Inhalten technisch feststellen, auch wenn für Endnutzer kein sichtbarer Hinweis vorhanden ist. Unternehmen sollten daher davon ausgehen, dass der KI-Ursprung ihrer Inhalte grundsätzlich erkennbar ist.

Was ist AI Washing und welche Folgen drohen?

AI Washing bezeichnet den umgekehrten Fall zur fehlenden KI-Kennzeichnung: Ein Unternehmen bewirbt sein Produkt oder seine Dienstleistung als auf KI basierend, obwohl tatsächlich keine oder keine nennenswerte KI-Komponente vorhanden ist. Ziel ist es, einen technologischen Vorteil gegenüber der Konkurrenz vorzutäuschen (d. dazu auch den Leitfaden der Wettbewerbszentrale).

Beispiele aus der Praxis:

- Ein Chatbot, der angeblich mit KI arbeitet, tatsächlich aber von menschlichen Mitarbeitern betrieben wird,

- Softwareprodukte, die mit „KI-gestützt” beworben werden, obwohl nur einfache Algorithmen zum Einsatz kommen,

- Investmentberatungen, die KI-basierte Entscheidungen versprechen, ohne dass eine KI tatsächlich eingesetzt wird.

Rechtliche Folgen:

- Wettbewerbsrecht (UWG): AI Washing ist eine irreführende Werbung über wesentliche Merkmale eines Produkts. Konkurrenten und Verbände können Unterlassung verlangen. Es gilt der Grundsatz: Wer KI verspricht, muss KI bieten.

- KI-Verordnung: Das UWG bleibt neben der KI-Verordnung anwendbar. Die KI-VO betont in Erwägungsgrund 29 ausdrücklich, dass unlautere Geschäftspraktiken unabhängig davon verboten sind, ob sie durch KI-Systeme umgesetzt werden.

- Aufsichtsrechtliche Maßnahmen: In den USA ist die SEC bereits gegen Unternehmen vorgegangen, die fälschlich KI-basierte Investmententscheidungen bewarben.

Welche Kennzeichnungspflichten bestehen neben der KI-Verordnung?

Kennzeichnungspflichten für KI-Inhalte ergeben sich nicht nur aus der KI-Verordnung. In der Praxis sind häufig zusätzliche Vorgaben zu beachten:

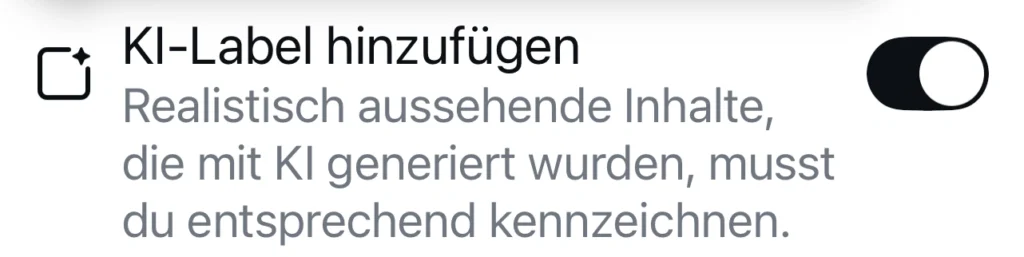

- Plattformregeln: Viele soziale Netzwerke und Hosting-Plattformen verlangen eine weitergehende Kennzeichnung von KI-generierten Inhalten, teilweise für sämtliche realistisch wirkenden Darstellungen, unabhängig davon, ob reale Personen oder Ereignisse gezeigt werden.

- Vertragliche Vorgaben: Kundenverträge, Kooperationsvereinbarungen oder Rahmenverträge können Offenlegungspflichten zum KI-Einsatz enthalten.

- Interne Richtlinien: Unternehmenseigene Compliance- oder Qualitätsvorgaben können eine Kennzeichnung auch dort verlangen, wo die KI-Verordnung keine Pflicht vorsieht.

- Branchenkodizes: Branchenspezifische Verhaltensregeln können weitergehende Transparenzanforderungen enthalten.

- Wettbewerbsrecht: Auch ohne ausdrückliche Kennzeichnungspflicht kann eine fehlende Offenlegung des KI-Einsatzes im Einzelfall als irreführende geschäftliche Handlung nach dem UWG gewertet werden.

Reicht die automatische KI-Kennzeichnung durch Plattformen aus?

Viele Plattformen erkennen KI-generierte Inhalte automatisch anhand von Metadaten und versehen sie mit einem entsprechenden Hinweis. Diese automatische Kennzeichnung durch die Plattform entbindet den Betreiber jedoch nicht von seiner eigenen Kennzeichnungspflicht nach der KI-Verordnung.

Die Pflicht zur Offenlegung trifft nach Art. 50 Abs. 4 KI-VO den Betreiber selbst. Er muss eigenständig sicherstellen, dass die Kennzeichnung klar, eindeutig und rechtzeitig erfolgt. Die Plattformkennzeichnung kann die Voraussetzungen erfüllen, muss aber nicht (z.B. wenn die KI-Kennzeichnung kaum lesbar ist).

Zudem sollten Betreiber beachten, dass Plattformen ihre Kennzeichnungssysteme jederzeit ändern können und die automatische Erkennung nicht bei allen KI-Systemen zuverlässig funktioniert. Daher ist die eigene Kennzeichnung stets sicherer.

Was passiert bei Verstößen gegen Plattformvorgaben?

Verstöße gegen die KI-Kennzeichnungsvorgaben von Plattformen können unabhängig von der KI-Verordnung erhebliche Konsequenzen haben:

- Löschung einzelner Inhalte,

- Reichweitenbeschränkungen für betroffene Beiträge oder den gesamten Account,

- Accountsperrungen, im Wiederholungsfall auch dauerhaft,

- Vertragliche Sanktionen auf Grundlage der Nutzungsbedingungen.

Die Plattformvorgaben können sich jederzeit ändern und gehen teilweise deutlich über die Anforderungen der KI-Verordnung hinaus. Vor jeder Veröffentlichung sollte daher geprüft werden, welche konkreten Vorgaben die jeweilige Plattform vorsieht.

Ersetzt die KI-Kennzeichnung die Prüfung auf Rechtmäßigkeit?

Nein. Eine Kennzeichnung als KI-Inhalt macht einen Inhalt nicht automatisch rechtmäßig. Auch wenn eine Veröffentlichung ordnungsgemäß als KI-generiert gekennzeichnet ist, muss ihre Zulässigkeit eigenständig geprüft werden. Die Kennzeichnung schützt also nicht vor Ansprüchen Dritter.

Beispiele:

- Urheberrecht: Eine unerlaubte KI-Kopie eines urheberrechtlich geschützten Bildes ist nicht urheberrechtlich zulässig.

- Persönlichkeitsrechte und Datenschutz: Ein KI-Bild, das eine erkennbare Person ohne deren Einwilligung zeigt, ist trotz KI-Hinweis rechtswidrig.

- Wettbewerbsrecht: Eine irreführende KI‑generierte Werbeaussage oder ein geschöntes Produktbild wird durch einen KI-Hinweis wettbewerbsrechtlich nicht zulässig.

- Verbotene KI-Praktik: Ein nach Artikel 5 KI-Verordnung verbotenes KI-System (z. B. ist eine Emotionserkennung am Arbeitsplatz) wird trotz ihrer Transparenz für Mitarbeitende verboten.

Gerade bei Darstellungen identifizierbarer Personen oder realitätsnahen Abbildungen kann eine Veröffentlichung trotz korrekter Kennzeichnung rechtswidrig sein.

Welche Rechte Dritter müssen trotz Kennzeichnung beachtet werden?

Unabhängig von einer KI-Kennzeichnung sind bei der Veröffentlichung von KI-generierten Inhalten insbesondere folgende Rechte eigenständig zu prüfen:

- Urheberrecht: KI-generierte Inhalte dürfen keine urheberrechtlich geschützten Werke ohne Erlaubnis reproduzieren oder nachahmen.

- Datenschutzrecht: Die Darstellung erkennbarer Personen kann eine Verarbeitung personenbezogener Daten darstellen, die einer Rechtsgrundlage bedarf.

- Persönlichkeitsrechte: Das Recht am eigenen Bild und der allgemeine Persönlichkeitsschutz gelten auch für KI-generierte Darstellungen.

- Wettbewerbsrecht: Irreführende oder herabsetzende Darstellungen können auch mit KI-Kennzeichnung wettbewerbswidrig sein.

- Markenrecht: Die Verwendung geschützter Marken in KI-generierten Inhalten kann Markenrechte verletzen.

Welche Rechtsfolgen drohen bei Verletzung von Persönlichkeitsrechten?

Wer KI-generierte Inhalte veröffentlicht, die erkennbare Personen ohne deren Einwilligung darstellen, kann sich erheblichen Rechtsfolgen aussetzen, und zwar unabhängig davon, ob der Inhalt als KI-generiert gekennzeichnet ist:

- Unterlassungsansprüche: Die betroffene Person kann die sofortige Entfernung und künftige Unterlassung verlangen.

- Schadensersatz: Bei schuldhafter Verletzung des Persönlichkeitsrechts können Schadensersatzansprüche bestehen, einschließlich Geldentschädigung bei schwerwiegenden Eingriffen.

- Strafrechtliche Konsequenzen: Bei ehrverletzenden Deepfakes drohen Freiheitsstrafen wegen Beleidigung (§ 185 StGB), übler Nachrede (§ 186 StGB) oder Verleumdung (§ 187 StGB) von bis zu fünf Jahren.

- Wettbewerbsrechtliche Ansprüche: Die unbefugte Nutzung des Bildnisses einer Person zu Werbezwecken kann zusätzlich wettbewerbsrechtliche Unterlassungs- und Schadensersatzansprüche auslösen.

Die KI-Kennzeichnung schützt in keinem dieser Fälle vor den Ansprüchen der betroffenen Person.

Das Wichtigste zu den KI-Kennzeichnungspflichten zusammengefasst

Die Transparenzpflichten der KI-Verordnung sind keine Nebensache, sondern eine zentrale Compliance-Anforderung für jeden, der KI-Systeme beruflich nutzt oder bereitstellt. Die wichtigsten Punkte:

- Ab August 2026 verbindlich: Die Kennzeichnungspflichten nach Art. 50 KI-Verordnung gelten ab dem 2. August 2026. Die Transparenzpflichten der KI-Anbieter gelten ab dem 02. Dezember 2026.

- Betreiber und Anbieter betroffen: Die Pflichten treffen nicht nur Hersteller von KI-Systemen, sondern auch jedes Unternehmen, jeden Selbstständigen und jede Behörde, die KI beruflich einsetzt oder unter eigenem Namen bereitstellt. Rein private Nutzung ist ausgenommen.

- Deepfakes kennzeichnen: KI-generierte Bild-, Video- oder Audioinhalte, die realen Personen, Orten oder Ereignissen ähneln und als echt erscheinen könnten, müssen als KI-Erzeugnisse offengelegt werden. Im Zweifel kennzeichnen.

- KI-Texte nur bei öffentlichem Interesse: Die Kennzeichnungspflicht für Texte betrifft nur Inhalte, die der Information der Öffentlichkeit dienen und ohne echte redaktionelle Kontrolle veröffentlicht werden. Werbetexte und Marketinginhalte sind in der Regel nicht erfasst.

- Doppelte Kennzeichnung empfehlenswert: Ein sichtbarer Hinweis im Inhalt selbst (z. B. Wasserzeichen) plus ein Hinweis im Begleittext bietet die größte Rechtssicherheit.

- Chatbots erkennbar machen: Anbieter müssen sicherstellen, dass Nutzer spätestens zu Beginn der Interaktion erkennen, dass sie mit einer KI kommunizieren. Versteckte Hinweise in AGB oder Impressum genügen nicht.

- Klar, sichtbar, barrierefrei: Die Kennzeichnung muss in klarer Sprache, spätestens beim ersten Kontakt mit dem Inhalt und barrierefrei erfolgen. Im deutschsprachigen Raum sollte sie auf Deutsch formuliert sein.

- Plattformregeln beachten: Viele Plattformen verlangen weitergehende Kennzeichnungen als die KI-Verordnung. Die automatische Erkennung durch Plattformen entbindet nicht von der eigenen Pflicht.

- Kennzeichnung ersetzt keine Rechtmäßigkeitsprüfung: Ein KI-Hinweis macht einen rechtswidrigen Inhalt nicht zulässig. Urheberrecht, Datenschutz, Persönlichkeitsrechte und Wettbewerbsrecht müssen unabhängig davon geprüft werden.

- Erhebliche Sanktionen: Verstöße können Bußgelder bis zu 15 Millionen Euro oder 3 Prozent des weltweiten Jahresumsatzes nach sich ziehen. Zusätzlich drohen wettbewerbsrechtliche Abmahnungen, zivilrechtliche Ansprüche und bei ehrverletzenden Deepfakes auch strafrechtliche Konsequenzen.

Gibt es EU-Seiten mit Anleitungen oder Hinweisen zur KI-Kennzeichnung?

Die EU-Kommission hat einen “Entwurf der Leitlinien zur Umsetzung der Transparenzpflichten für bestimmte KI-Systeme nach Artikel 50 der KI-Verordnung” bereitgestseellt. Die Leitlinien erläutern die Transparenzpflichten nach Art. 50 KI-VO, insbesondere zu:

- KI-Interaktionen, etwa Chatbots und KI-Agenten,

- maschinenlesbarer Kennzeichnung KI-generierter Inhalte,

- Deepfakes,

- KI-generierten Texten von öffentlichem Interesse,

- Emotionserkennung und biometrischer Kategorisierung,

- Anforderungen an klare, verständliche und barrierefreie Hinweise.

Die Leitlinien sind derzeit ein Entwurf und daher nicht rechtsverbindlich. Sie geben aber wichtige Hinweise darauf, wie die Europäische Kommission die Transparenzpflichten versteht. Maßgeblich bleiben der Wortlaut der KI-Verordnung und die spätere Auslegung durch Behörden und Gerichte.

Fazit

Die Transparenzpflichten der KI-Verordnung verfolgen das Ziel, Täuschungen zu vermeiden und Nutzern die Einordnung KI-generierter Inhalte zu ermöglichen. Sie greifen nicht flächendeckend, sondern abhängig von der Art des Inhalts, dem Realitätsbezug, dem Veröffentlichungszweck und dem Grad der menschlichen Kontrolle.

Die Pflichten treffen sowohl Anbieter als auch Betreiber von KI-Systemen und gelten ab dem 2. August 2026. Zusätzlich können vertragliche, plattformbezogene und wettbewerbsrechtliche Vorgaben weitergehende Kennzeichnungspflichten begründen. Verstöße können zu erheblichen Bußgeldern, zivilrechtlichen Ansprüchen und im Einzelfall auch zu strafrechtlichen Konsequenzen führen.

Wichtig: Eine KI-Kennzeichnung allein macht einen Inhalt nicht rechtmäßig. Urheberrecht, Datenschutz, Persönlichkeitsrechte und Wettbewerbsrecht müssen unabhängig von der Kennzeichnung beachtet werden.

Transparenz sollte daher nicht erst vor der Veröffentlichung geprüft werden. Bereits bei Konzeption und Erstellung von Inhalten ist festzulegen, ob ein KI-Einsatz offenlegungspflichtig sein könnte. Je höher die Erwartung des Publikums an Authentizität und menschliche Urheberschaft, desto eher ist eine klare Kennzeichnung angezeigt. Im Zweifel empfiehlt sich eine Kennzeichnung, da die Gerichte die Anforderungen noch nicht abschließend konkretisiert haben.

Tipp für mehr Rechtssicherheit

Mit unserem Generator können Sie rechtssichere KI-Richtlinien für Mitarbeitende erstellen. Diese enthalten Regelungen zum Umgang mit KI durch Mitarbeitende. Zudem können Sie KI-Systeme aus unserer Datenbank auswählen, die für Mitarbeitende freigegeben werden sollen. Testen Sie den Generator jetzt unverbindlich und ohne Registrierung: